Бұл ғасыр – жасанды интеллект ғасыры. Ғалымдар енді әлем бұрынғыдай болмайды деп дабыл қағуда. Себебі жасанды интеллект тек деректерді өңдеп қана қоймай, барлық саланы жаулап үлгерді. Соның ішінде жарнама, маркетингті. Мәселен, бұрындары әлдебір өнімді жарнамалау үшін танымал тұлғаларға қомақты қаржы ұсынып жатса, бүгінде жасанды интеллект арқылы олардың дауысы мен келбетін көшіріп, кез келген тауарды жарнамалауға болады. Бұл құрал – дипфейк деп аталады.

Дипфейк: ол не?

Дипфейк – «deep» (терең) және «fake» (жалған) сөздерінен құралған. Жоғарыда атап кеткендей, осы технология арқылы адамдардың бейнелері мен дыбыстары өзгертіліп, оларды басқа контекстте қолдануға болады. Мәселен, бір адамның бет-әлпетін басқа адамның бетіне қою немесе белгілі бір адамның дауысын мүлдем басқа сөздермен сөйлету. Дипфейктердің жылдам таныл-ғанына, шындықты бұрмалап, адамдарды алдауға мүмкіндік беретіні әсер етті.

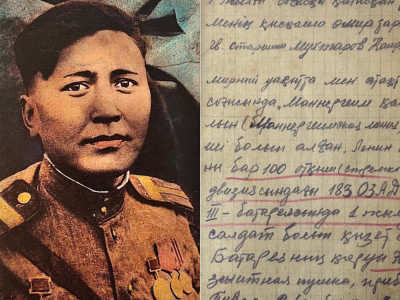

Қазір дипфейк түрлі салаларда қолданылады: киноиндустрияда, маркетингте, көптеген әлеуметтік желіде, журналистикада және көпшілікке арналған көгілдір экран мен мәдени шараларда. Бұл жасанды бейне мықты нейрондардың көмегі арқылы жұмыс жасайды. Яғни, дипфейк пен нейрондардың арасында тығыз байланыс бар. Соның арқасында кез келген адамның түрін, дауысын келтіре отырып фото, видео және аудиожазбаларды жасауға болады. Тіпті, түпнұсқасынан ажырату қиын. Сонымен қатар өміріңізде айтпаған сөздерді айтып, аяқ баспаған жерде жүріп, жасамаған әрекетті жасау мүмкіндігіне ие боласыз. Таңғаларлығы – бұл технология тек тірі адамдардың бейнесін алмастырумен шектелмейді. Өмірден өткен тұлғаларға «жан бітіру» мүмкіндігі бар.

Дипфейк технологиясының кемшіліктерімен қоса артықшылықтары да бар. Нақтырақ айта кетсек, бұл технология, шығармашылық саласында жаңа мүмкіндіктер туғызады. Мысалы, жоғарыда атап өткендей, киноиндустрияда актерлердің бейнелерін заманауи тәсілдермен өңдеу арқылы жаңа туындылар жасауға болады. Сонымен қатар білім беру саласында да бұл технология арқылы оқыту процесін интерактивті етіп, оқушылар мен студенттердің қызығушылығын арттырады. Тарихи тұлғалардың фотосына «жан беру», дыбыстау арқылы виртуалды шынайылыққа бір қадам жақындай түседі. Мәселен, Кенесары немесе Қасым хандардың бейнесін жаңғыртып, олардың дауысы мен сөздерін есту оқушыға жай ғана мәтін оқығаннан гөрі әлдеқайда әсерлі болады. Ал екінші тарапта, жеке бас тұлғалардың, азаматтардың құпия деректеріне дәл осы дипфейк арқылы түрлі кибершабуылдар жасалып, ұрланып жатады. Бұл зиянның бер жағы ғана. Қазіргі кездегі өзекті мәселелердің бірі – алаяқтардың біреудің жеке бас деректерін қолдан жасап, адамдардың банктік шоттарына қол жеткізіп, ондағы ақшаны өз пайдасына жаратып, жалған несие рәсімдеуі.

Дипфейктермен күресудің

әдіс-тәсілдері

Inbusiness.kz. сайтындағы ақпаратқа сүйенсек, Ресей фейк жаңалықтарға қарсы қатал шараларды енгізген алғашқы елдердің бірі. 2019 жылдан бері елде қоғамдық маңызы бар ақпаратты әдейі жалған тарату үшін әкімшілік және қылмыстық жауапкершілікті қарастыратын заң күшіне енді. Азаматтарға салынатын айыппұл 100 мың, лауазымды тұлғаларға – 300 мың, ал заңды тұлғаларға – 1 миллион рубльге дейін жетеді. Егер жалған ақпарат адамдардың өмірі мен денсаулығына қауіп төндірсе немесе жаппай тәртіпсіздіктерді туындатуы мүмкін болса, айыппұлдар артады, ал кінәлілер 15 жылға дейін бас бостандығынан айырылуы мүмкін. Сингапур әлемдегі ең қатал дезинформациямен күрес заңдарының бірімен танымал. POFMA (Protection from Online Falsehoods and Manipulation Act) заңы қоғамдық пікірге, сайлауға немесе ұлттық қауіпсіздікке әсер ете алатын жалған ақпаратты әдейі тарату үшін 50 мың АҚШ доллары көлемінде айыппұл немесе 5 жылға дейін бас бостандығынан айыруды қарастырады. Фейктерді тарату үшін автоматтандырылған құралдарды (мысалы, боттарды) қолдану одан да қатал жазаланады – 100 мың доллар айыппұл және 10 жылға дейін түрмеге жазасы.

Біздің елде бұл күрес қалай жүріп жатыр?

Елімізде де дипфейк технологиясы арқылы жасалып жатқан алаяқтық факторлар көптеп тіркеліп жатыр. Әсіресе, бұл үрдіс жарнама бағытында белең алып тұр.

Енді әңгімемізді нақты мысалдармен өрбітсек: Дана Нұржігіт – тележурналист, продюсер, қоғам қайраткері. Ол өзінің Instagram-парақшасында Димаш Құдайбергенмен ертеректе жасаған сұхбатын бір компания бұрмалап, өздеріне жарнама жасағанын жариялады. Видеоның басы Дана Нұржігіттің Димаш Құдайбергенге «маңызды ақпаратыңмен бөліскің келгенін білеміз» деп сөз беруімен басталады. Бұл видеоны жасанды интеллект арқылы өте сапалы жасағаны соншалық, бір көргенде сенбеуіңіз мүмкін емес. Дауыстары, бет әлпеттері, мимика – барлығы айнытпай жасалынған. Бұл видеоның астына Дана Нұржігіт: «Абайлаңыздар, deep fake! Жасанды интеллект Димаш екеумізді де фейк жарнамаға қосыпты! Сенбеңіздер!» – деп жазба қалдырған. Желі қолданушылары бұл орайда екі тарапқа бөлінді: бірі жасанды интеллекттің берер зияны осы десе, бірі Димашқа сенетінін жазып кеткен.

2024 жылы әлеуметтік желілерде танымал актер Рүстем Омаровтың бейнесі мен дауысы қолданылған дипфейк жарнама пайда болды. Бұл бейнероликте Рүстем Омаровтың белгілі бір сұхбатының бөлігін жасанды интеллект арқылы кесіп алып, кредит жабу жөнінде таза қаржылық пирамиданың жарнамасын жасаған. Осыны көрген Рүстемнің өзі халыққа алданбаңыздар деп үндеу жасады.

2025 жылдың басынан бері Қазақстанда жалған ақпарат тарату бойынша 34 қылмыстық іс қозғалды, олардың тек үшеуі әйелдерге қатысты. Интернет-ресурстарды заңсыз пайдалану туралы бір іс тіркелді. Жылдың алғашқы айларында 246 заңсыз жарияланым анықталды, оның 232-сі әлеуметтік желілерде тараған. «Анализ және ақпарат орталығы» онлайн кеңістікті мониторингтеп, заңсыздықтарды уәкілетті органдарға жедел жеткізеді. Заңсыздық анықталған жағдайда платформа иелеріне фейк контентті жою туралы хабарламалар жіберіледі. Құқық бұзушылықтар туралы мәліметтер ІІМ-ге беріледі. Министрлік ірі платформалармен өзара байланыс үшін арнайы механизмдер әзірледі, мысалы, Facebook автоматтандырылған жүйе арқылы хабарламалар алады, ал YouTube үшін ресми хаттар дайындалады.

Елімізде де, әлемде де мұндай оқиға өте көп. Қазір бұл мысалдардан да асып түсетін жайттар орын алып жатыр. Сондықтан дипфейктен сақтану керек екенін естен шығармағанымыз жөн. Сондай-ақ бұл технологияны жауапкершілікпен пайдалануымыз керек, ол үшін ақпараттық сауат аса маңызды.

Әсел СҮЛЕЙМЕН,

Еуразия ұлттық университетінің

ІІ курс студенті